Observed Exposure évalue l’usage effectif de l’IA au travail en croisant O*NET, estimations de capacités LLM et logs d’utilisation de Claude (Anthropic, mars 2026). Cette approche replace le débat sur l’emploi sur des faits mesurables — lisez pour comprendre les implications concrètes pour votre organisation.

Besoin d'aide ? Découvrez les solutions de notre agence IA.

Pourquoi cette recherche change-t-elle la façon de mesurer l’impact ?

Les approches antérieures fondées sur les tâches — notamment les travaux inspirés par Frey et Osborne (2013) — évaluent l’exposition à l’automatisation en appariant des tâches professionnelles décrites dans O*NET à des capacités techniques des modèles d’IA. Cette méthode mesure essentiellement une exposition théorique : ce que l’IA pourrait faire si toutes les conditions étaient réunies. Cette logique conduit souvent à une surestimation de l’impact réel, parce que la disponibilité d’une capacité n’implique pas son intégration dans les opérations quotidiennes.

O*NET fournit des descriptions détaillées pour près de 1 000 professions et des centaines d’activités de travail, ce qui en fait une base pratique pour ces appariements tâches-capacités. Cependant, l’appariement ne capture pas le contexte d’utilisation — par exemple la fréquence d’une tâche, les coûts d’intégration, les contraintes réglementaires, ou l’acceptation par les équipes. Anthropic met en avant une intuition clé : la présence d’une capacité ne garantit pas son déploiement opérationnel — le « showing-up ».

Conséquences pratiques : Les décideurs qui s’appuient uniquement sur des évaluations de capacité risquent de surinvestir dans des projets d’automatisation peu rentables, de mal calibrer la planification RH, et de négliger les investissements nécessaires pour que l’IA « apparaisse » effectivement dans les processus (intégration technique, formation, changement de procédures).

- Fréquence d’utilisation : La capacité à exécuter une tâche n’indique pas à quelle fréquence elle sera utilisée dans le workflow réel.

- Intégration opérationnelle : L’usage dépend des coûts d’intégration, des interfaces et des processus métiers existants.

- Accessibilité et coût : La disponibilité technique peut être limitée par prix, latence, ou contraintes d’infrastructure.

- Acceptation humaine et conformité : Les décisions humaines, la confiance et la régulation influencent l’adoption effective.

| Problème | Mesure antérieure | Approche Observed Exposure |

| Surestimation de l’impact | Appariement tâches-capacités donnant une exposition théorique. | Mesure de l’usage réel observé dans les requêtes et les intégrations. |

| Utilité pour la décision | Prédictions statiques, peu opérationnelles pour la planification RH. | Indicateurs dynamiques utiles pour prioriser projets et formations. |

| Temporalité | Snapshot basé sur capacités disponibles. | Observation continue de la « présence » effective des capacités en production. |

Qu’est-ce que l’Observed Exposure exactement ?

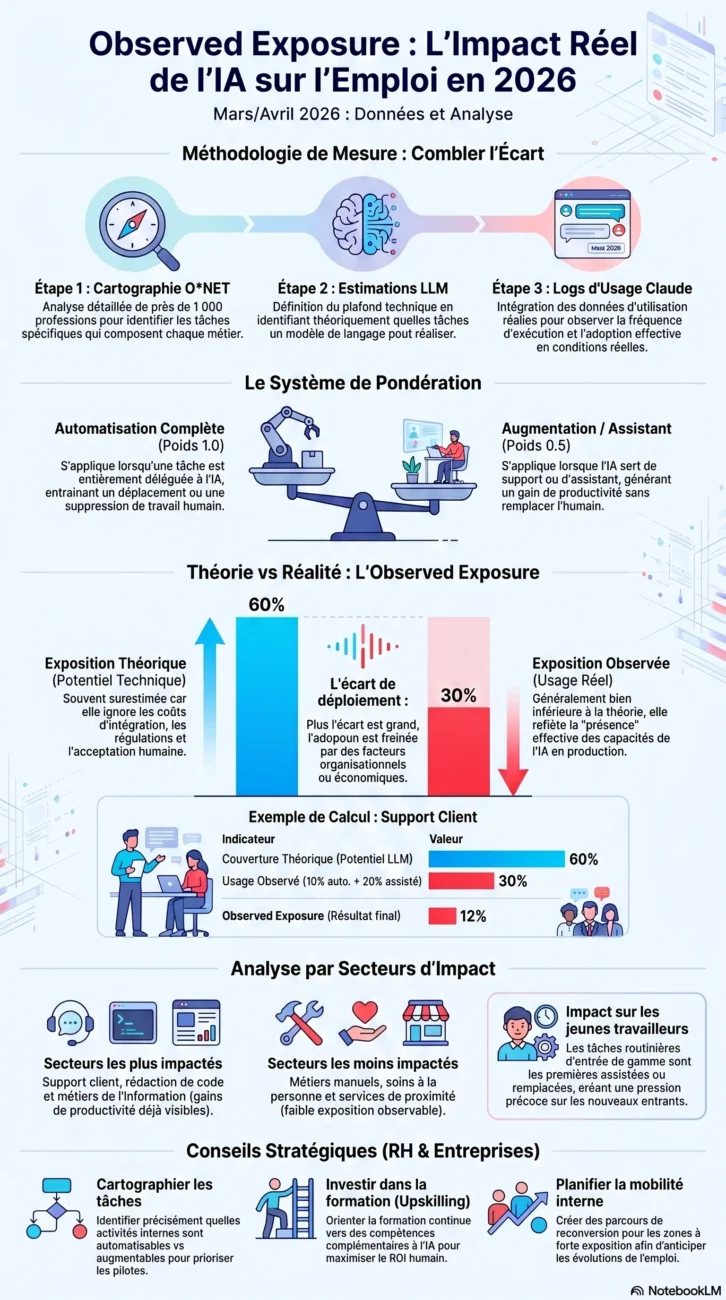

Observed Exposure croise (1) la cartographie des tâches O*NET (~800 métiers analysés), (2) des estimations antérieures de la couverture des tâches par les LLM, et (3) des données d’utilisation réelles issues de Claude (logs d’usage).

- O*NET (cartographie des tâches) : Fournit la granularité métier-tâche nécessaire pour savoir quelles actions composent un emploi. Cette source est robuste pour la standardisation et la comparaison inter-métiers. Cette source montre toutefois des limites de mise à jour et peut ne pas capter des tâches émergentes ou des variations locales.

- Estimations antérieures de couverture par les LLM : Indiquent théoriquement quelles tâches un modèle de langage peut réaliser ou aider à réaliser. Ces estimations sont utiles pour définir un plafond technique d’automatisation. Ces estimations restent cependant théoriques et peuvent surestimer l’adaptabilité en conditions réelles.

- Données d’utilisation issues de Claude : Mesurent l’usage effectif dans des environnements productifs (logs, requêtes, patterns d’usage). Ces données donnent une vision empirique de l’adoption et des modes d’utilisation (automatisation vs assistant). Ces données peuvent souffrir d’un biais de plateforme et d’un échantillonnage non représentatif de tous les secteurs.

Logique de pondération : Les implémentations entièrement automatisées reçoivent un poids complet (poids = 1). Les usages augmentatifs ou en mode assistant reçoivent un poids réduit (poids ≈ 0,5). Cette distinction est cruciale parce que la conséquence opérationnelle d’une tâche entièrement automatisée (suppression ou déplacement de travail) est très différente d’un simple gain de productivité ponctuel.

Exemple hypothétique pour un métier de support client :

| Couverture théorique | 60% |

| Usage observé (part des tâches utilisant l’IA) | 30% (dont automatisé 10%, augmentatif 20%) |

| Calcul pondéré | Poids = 1*0,10 + 0,5*0,20 = 0,20 |

| Observed Exposure (résultat) | 0,60 * 0,20 = 0,12 → 12% des tâches impactées opérationnellement |

Note méthodologique : Les limites principales incluent le biais d’échantillonnage de Claude, l’arbitraire relatif des pondérations et l’évolution rapide des usages dans le temps. Ces chiffres doivent donc être interprétés comme des estimations dynamiques et indicatives, non comme des mesures définitives.

Quelles sont les principales conclusions et que faire maintenant ?

Je synthétise ici les conclusions clés issues de l’étude Observed Exposure et ce que vous pouvez faire maintenant pour limiter les risques et saisir les opportunités.

- Écart fréquent entre couverture théorique et usage observé. Les modèles indiquent souvent qu’un grand nombre de tâches sont « automatisables », mais l’usage réel demeure bien inférieur; Cela implique de ne pas confondre potentiel technique et déploiement effectif.

- Certaines catégories montrent déjà un usage effectif de l’IA. Les travaux informationnels, le support client et l’assistance au code sont des exemples où les gains de productivité sont visibles; Cela signifie que ces secteurs exigent des stratégies d’adaptation immédiates.

- Une large part de l’économie reste peu touchée aujourd’hui. Les métiers manuels, de soins et certains services de proximité présentent une faible exposition observable; Cela laisse du temps pour anticiper, former et redessiner les postes.

- Corrélation entre exposition IA élevée et croissance d’emploi plus faible à long terme. Les régions et secteurs fortement exposés montrent des trajectoires d’emploi plus lentes; Cela suggère un besoin de politiques de reconversion ciblées plutôt que de paniques générales.

- Absence d’un choc massif et immédiat sur le chômage. Les changements apparaissent progressifs, liés au rythme d’adoption des entreprises; Cela autorise des réponses calibrées mais persistantes.

- Pression précoce possible sur les travailleurs plus jeunes. Les tâches routinières embauchées à bas coût sont les premières remplacées ou assistées; Cela impose d’orienter la formation initiale vers des compétences complémentaires à l’IA.

Le graphique clé oppose une courbe/zone bleue (couverture théorique) et une courbe/zone rouge (couverture observée). Lire l’écart revient à mesurer le delta entre ce que les modèles prédisent et ce que les entreprises utilisent réellement; Plus l’écart est grand, plus l’adoption est freinée par des facteurs organisationnels, régulatoires ou économiques.

- Pour les entreprises : Cartographier les tâches, lancer pilotes ciblés, investir dans la formation interne, redessiner les rôles autour des compétences humaines.

- Pour les responsables RH : Mettre en place plans de reskilling, ajuster les recrutements vers compétences complémentaires, mesurer l’impact des outils IA, créer parcours de mobilité interne.

- Pour les décideurs publics : Financer la formation continue, soutenir l’innovation responsable, renforcer les services d’orientation professionnelle, améliorer la collecte de données sectorielles.

| Entreprises | Surestimer déploiement | Piloter par tâches et upskilling ciblé |

| Responsables RH | Pénurie de compétences complémentaires | Programmes de reskilling et mobilité interne |

| Décideurs publics | Désajustements régionaux | Financer formation et collecte de données |

Que devez-vous retenir pour agir dès maintenant ?

Observed Exposure recentre le débat sur l’emploi en passant de la capacité théorique à l’usage effectif : en combinant O*NET, estimations de couverture LLM et logs de Claude, Anthropic montre qu’une large part de l’économie reste peu affectée aujourd’hui, tandis que certains secteurs voient une adoption réelle. Pour vous, cela signifie prioriser la mesure de l’adoption et piloter des expérimentations ciblées plutôt que de vous fier uniquement aux estimations théoriques. Bénéfice concret : décisions RH et projets d’automatisation plus rentables, moins de risque d’investissements mal alignés.

FAQ

- Qu’est-ce que l’Observed Exposure d’Anthropic ?

Observed Exposure est une métrique qui mesure où l’IA est effectivement utilisée au travail en croisant la cartographie des tâches (O*NET), des estimations de couverture LLM et des données d’usage réelles issues de Claude (Anthropic, mars 2026). - En quoi diffère-t-elle des estimations théoriques ?

Les estimations théoriques évaluent ce que l’IA pourrait faire. Observed Exposure mesure ce qui est déjà déployé et utilisé, en pondérant différemment l’automatisation complète et l’usage augmentatif. - Quelles sources de données sont utilisées ?

La méthode combine la base de tâches O*NET, des études antérieures sur la couverture des tâches par les LLM, et des logs réels d’utilisation du modèle Claude fournis par Anthropic. - Est-ce que cela signifie que l’IA ne supprime pas d’emplois ?

Non, pas automatiquement. L’étude montre qu’à date l’usage observé est souvent plus faible que la capacité théorique, mais certaines catégories d’emplois montrent déjà des impacts réels et une pression possible sur la croissance d’emploi à long terme. - Que doivent faire les entreprises maintenant ?

Mesurer l’adoption interne, prioriser les cas d’usage à fort ROI et faible friction, piloter des automations ciblées, et suivre l’évolution de l’usage réel plutôt que les seules capacités théoriques des modèles.

A propos de l’auteur

Franck Scandolera — Expert & formateur en tracking server-side, Analytics Engineering, automatisation No/Low Code (n8n) et intégration de l’IA en entreprise. Responsable de l’agence webAnalyste et de l’organisme Formations Analytics. Références clients : Logis Hôtel, Yelloh Village, BazarChic, Fédération Française de Football, Texdecor. Dispo pour aider les entreprises => contactez moi.

⭐ Analytics engineer, Data Analyst et Automatisation IA ⭐

- Ref clients : Logis Hôtel, Yelloh Village, BazarChic, Fédération Football Français, Texdecor…

Mon terrain de jeu :

- Data Analyst & Analytics engineering : tracking avancé (GA4, Matomo, Piano, GTM server, Tealium, Commander Act, e-commerce, CAPI, RGPD), entrepôt de données (BigQuery, Snowflake, PostgreSQL, ClickHouse), modèles (Airflow, dbt, Dataform), dashboards décisionnels (Looker, Power BI, Metabase, SQL, Python).

- Automatisation IA des taches Data, Marketing, RH, compta etc : conception de workflows intelligents robustes (n8n, App Script, scraping) connectés aux API de vos outils et LLM (OpenAI, Mistral, Claude…).

- Engineering IA pour créer des applications et agent IA sur mesure : intégration de LLM (OpenAI, Mistral…), RAG, assistants métier, génération de documents complexes, APIs, backends Node.js/Python.